논문 브리핑

매개변수 효율성이 곧 메모리 효율성은 아니다: 온디바이스 LLM 적응을 위한 미세 조정 재고

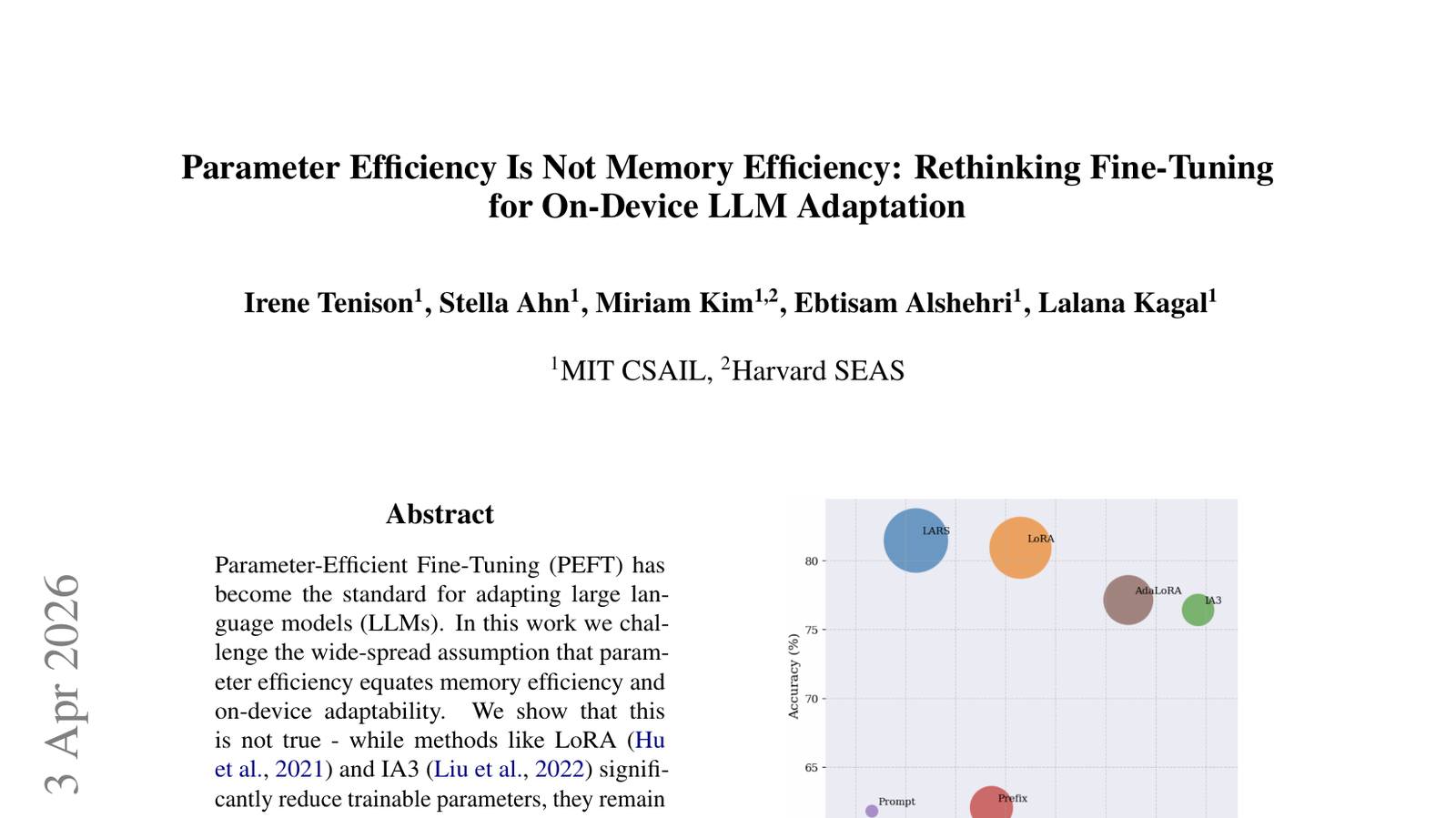

'Parameter Efficiency Is Not Memory Efficiency: Rethinking Fine-Tuning for On-Device LLM Adaptation'이라는 논문은 매개변수 효율적 미세 조정(PEFT)이 LLM 적응의 표준으로 자리 잡았지만, 이것이 항상 메모리 효율성과 직결되지는 않는다는 중요한 질문을 던집니다. 기존에는 매개변수 효율성이 메모리 효율성으로 이어진다는 광범위한 가정이 있었지만, 이 연구는 이러한 가정을 재고해야 한다고 주장합니다. 온디바이스(on-device) LLM의 핵심은 제한된 하드웨어 자원에서 모델을 효율적으로 실행하는 것인데, 매개변수 수를 줄이는 것만으로는 충분하지 않을 수 있다는 것입니다. 실제 메모리 사용량, 연산 부하, 그리고 전력 소모 등 다양한 요소들을 종합적으로 고려해야 합니다. 이 논문은 PEFT 기법들이 실제로 온디바이스 환경에서 얼마나 효율적인지, 그리고 메모리 제약이 심한 환경에 최적화된 새로운 미세 조정 전략이 필요함을 강조합니다. 이는 스마트폰, 엣지 디바이스, 그리고 임베디드 시스템에서 LLM을 구동하려는 노력에 중요한 시사점을 제공합니다. 매개변수 효율성만을 추구하는 것을 넘어, 실제 배포 환경에서의 총체적인 자원 사용량을 고려한 '진정한' 메모리 효율성을 달성하는 것이 온디바이스 AI의 성공을 위한 핵심 과제가 될 것입니다.

인사이트

이 논문은 매개변수 효율성이 메모리 효율성과 다르다는 점을 지적하며, 온디바이스 LLM 적응을 위해 매개변수 효율성뿐 아니라 실제 메모리 사용량 등 총체적 자원 사용량을 고려한 새로운 미세 조정 전략이 필요함을 강조합니다.

이 기사 어땠어요?

여러분의 피드백이 더 나은 맞춤 추천을 만듭니다.