논문 브리핑

선호도 최적화를 위한 내재적 상호 정보량 조절기

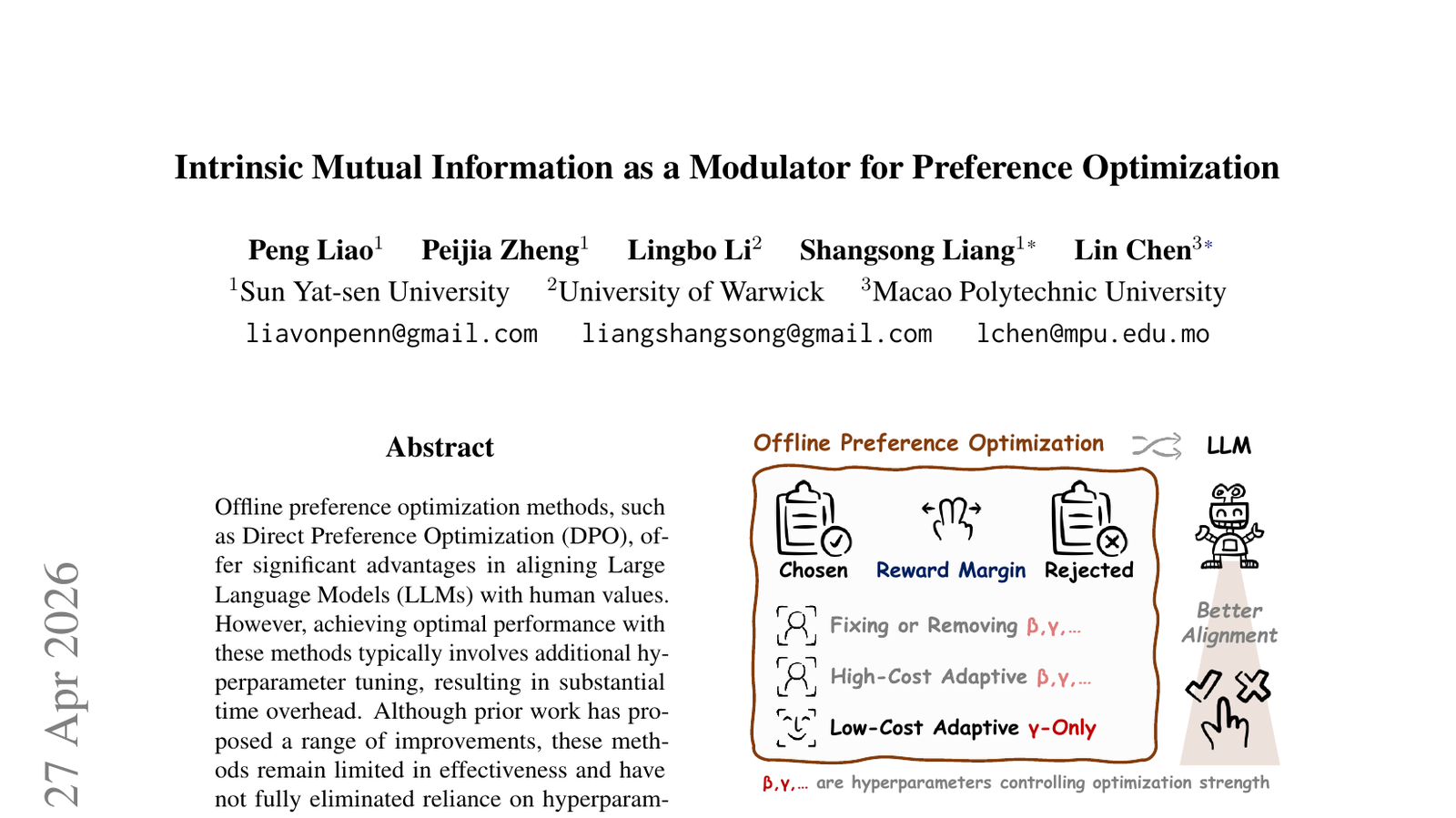

새로운 연구 논문 'Intrinsic Mutual Information as a Modulator for Preference Optimization'은 LLM(대규모 언어 모델)의 선호도 최적화(Preference Optimization, PO) 과정에서 '내재적 상호 정보량(Intrinsic Mutual Information, IMI)'을 조절기로 활용하는 방법을 제안합니다. DPO(Direct Preference Optimization)와 같은 오프라인 선호도 최적화 방법은 LLM을 인간의 선호도에 맞춰 정렬하는 데 중요한 역할을 하지만, 때로는 모델이 과도하게 '안전한' 답변만을 생성하거나 창의성을 잃는 문제가 있었습니다. 이 논문은 IMI를 통해 모델의 내부 상태와 출력 간의 정보 흐름을 조절하여, 인간의 선호도를 따르면서도 모델의 다양성과 유연성을 유지할 수 있는 방안을 모색합니다. 즉, AI가 단순히 정답을 맞추는 것을 넘어, '인간이 선호하는' 방식으로 작동하도록 훈련하되, 모델의 본래적인 정보 처리 능력을 해치지 않으려는 시도입니다. 이는 LLM이 단순히 '유용한' 것을 생성하는 것을 넘어 '인간적인' 혹은 '창의적인' 답변을 생성할 수 있도록 유도하는 데 중요한 의미를 가집니다. 특히 AI 모델의 '정렬(Alignment)' 문제를 해결하는 데 있어, 윤리적 기준과 사용자 경험을 동시에 만족시키는 방법을 찾는 것은 매우 중요합니다. 이 연구는 모델의 출력을 제어하는 동시에, 모델의 내재적 지식과 능력을 최대한 활용함으로써 AI의 활용 범위를 넓히는 데 기여할 수 있습니다. 이는 AI가 더욱 복잡하고 미묘한 인간의 의도를 이해하고 반영할 수 있도록 진화하는 데 중요한 발판이 될 것입니다.

이 논문은 LLM 선호도 최적화에 내재적 상호 정보량을 활용하여 모델의 다양성과 유연성을 유지하는 방법을 제시하며, AI의 '정렬' 문제 해결에 새로운 접근법을 제공합니다. 이는 AI가 인간의 선호도를 따르면서도 창의성과 본래적 능력을 잃지 않도록 하는 데 중요하며, AI 모델의 윤리적 사용과 사용자 경험 개선에 기여할 것입니다. 결국, 이 연구는 AI가 단순히 유용한 도구를 넘어 인간의 가치와 미묘한 감정을 이해하는 지능형 시스템으로 진화하는 데 필요한 핵심 기술을 탐구합니다.

인사이트

이 논문은 LLM 선호도 최적화에 내재적 상호 정보량을 활용하여 AI가 인간의 선호도를 따르면서도 창의성을 유지하는 방법을 제시, AI '정렬' 문제 해결에 중요한 진전을 이룹니다.

이 기사 어땠어요?

여러분의 피드백이 더 나은 맞춤 추천을 만듭니다.