논문 브리핑

통합 정보 이론적 목표를 통한 KV 캐시 축출 재고

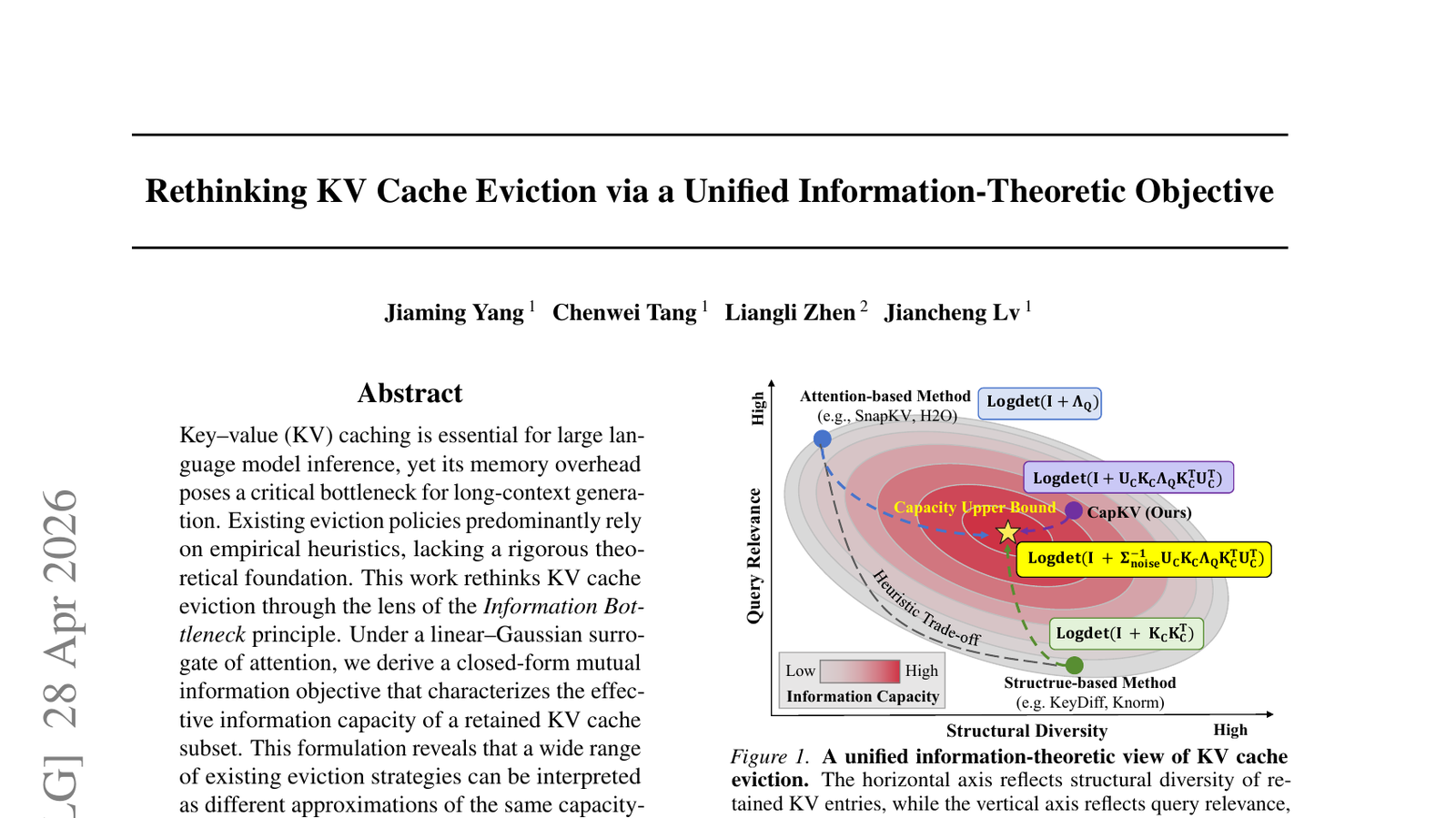

대규모 언어 모델(LLM) 추론에 필수적인 KV 캐시(Key-Value Cache)는 긴 컨텍스트 생성을 위한 메모리 오버헤드라는 중요한 병목 현상을 초래합니다. 새로운 논문 'Rethinking KV Cache Eviction via a Unified Information-Theoretic Objective'는 이러한 KV 캐시 축출(eviction) 전략을 통합 정보 이론적 목표를 통해 재고할 것을 제안합니다. 기존의 캐시 축출 기법들은 주로 시간적 지역성이나 사용 빈도에 기반했지만, 이 논문은 정보의 중요도를 기반으로 어떤 토큰을 캐시에서 유지하고 어떤 토큰을 제거할지 결정하는 새로운 접근 방식을 탐구합니다. 이는 LLM이 더 긴 텍스트를 처리하고, 더 복잡한 추론을 수행할 때 발생하는 메모리 제약을 효과적으로 완화할 수 있습니다. KV 캐시 효율성 향상은 LLM의 성능을 높이고, 추론 비용을 절감하며, 더 긴 컨텍스트 윈도우를 지원하는 데 핵심적인 역할을 합니다. 이는 특히 기업이 LLM을 실제 서비스에 적용할 때 중요한 운영 효율성 문제와 직결됩니다. 이 연구는 LLM의 아키텍처와 작동 방식에 대한 깊은 이해를 바탕으로, 하드웨어적 제약을 소프트웨어적으로 극복하려는 중요한 시도를 보여줍니다. 이러한 최적화 노력은 LLM이 더욱 광범위한 애플리케이션에 적용될 수 있는 길을 열어줄 것이며, AI 기술의 상용화 속도를 가속화하는 데 기여할 것입니다. 효율적인 KV 캐시 관리는 LLM 추론의 미래를 결정하는 중요한 기술적 요소입니다.

인사이트

이 논문은 LLM의 KV 캐시 축출을 정보 이론적 목표로 재해석하여 메모리 효율성을 극대화합니다. 이는 LLM의 긴 컨텍스트 처리 능력을 향상시키고, 추론 비용을 절감하여 AI 기술의 광범위한 상용화를 가능하게 할 것입니다.

이 기사 어땠어요?

여러분의 피드백이 더 나은 맞춤 추천을 만듭니다.