논문 브리핑

LLM Jailbreak 성공 메커니즘 해부: 안전 우회 경로의 기술적 분석

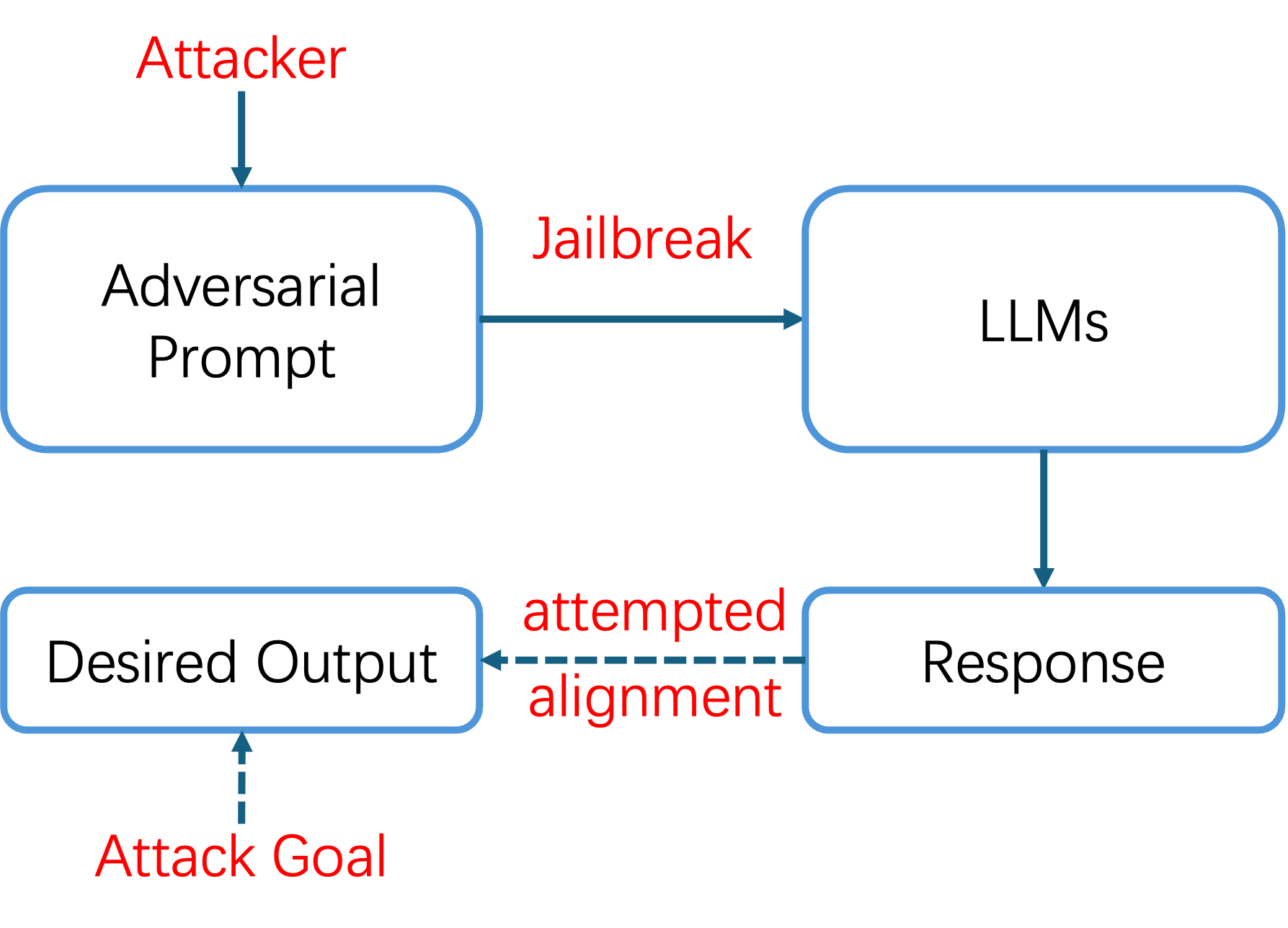

최근 arXiv에 발표된 논문 'Explaining Jailbreak Success in LLMs — 안전 우회의 메커니즘 분석'은 LLM(거대 언어 모델)의 'jailbreak'(안전 우회)가 성공하는 이유를 모델 내부 메커니즘 관점에서 심층적으로 분석하여 AI 안전 연구에 중요한 기여를 했습니다. LLM은 유해하거나 위험한 콘텐츠 생성을 방지하기 위한 안전 가드(safety guard) 메커니즘을 내장하고 있지만, 사용자들은 다양한 프롬프트 엔지니어링 기법을 통해 이를 우회하는 'jailbreak'를 시도하고 성공하곤 합니다. 이 연구는 모델의 어텐션 패턴(attention patterns), 프롬프트 구조, 그리고 역할극(role-play) 설정의 복합적인 결합이 어떻게 안전 가드를 무력화하고 모델이 금지된 답변을 생성하도록 유도하는지 구체적인 경로를 규명했습니다. 예를 들어, 특정 단어의 사용 방식, 질문의 순서, 그리고 모델에 부여된 가상의 역할이 모델의 내부 상태를 변화시켜 안전 필터링을 회피하게 만드는 메커니즘을 밝혀냈습니다. 이러한 분석은 단순히 jailbreak 현상을 관찰하는 것을 넘어, 그 근본적인 원인을 기술적으로 이해하려는 시도입니다. 연구 결과는 LLM 개발자들이 안전 가드를 더욱 견고하게 설계하고, 새로운 형태의 우회 공격에 효과적으로 대응할 수 있는 방안을 모색하는 데 중요한 통찰을 제공합니다. 이는 AI의 윤리적이고 안전한 사용을 보장하기 위한 필수적인 연구이며, AI 모델의 투명성과 제어 가능성을 향상시키는 데 기여할 것입니다. AI 시스템이 더욱 복잡해지고 사회에 미치는 영향력이 커질수록, 이러한 안전 메커니즘에 대한 심도 깊은 이해와 지속적인 개선 노력이 더욱 중요해질 것입니다.

인사이트

LLM Jailbreak 성공 메커니즘 분석은 모델의 내부 작용을 통해 안전 가드 우회 경로를 규명함으로써, LLM 개발자들이 더욱 견고하고 효과적인 안전 메커니즘을 설계할 수 있는 중요한 기술적 통찰을 제공합니다.

이 기사 어땠어요?

여러분의 피드백이 더 나은 맞춤 추천을 만듭니다.