논문 브리핑

해석 가능성을 통한 주석자 안전 정책 이해 (Understanding Annotator Safety Policy with Interpretability)

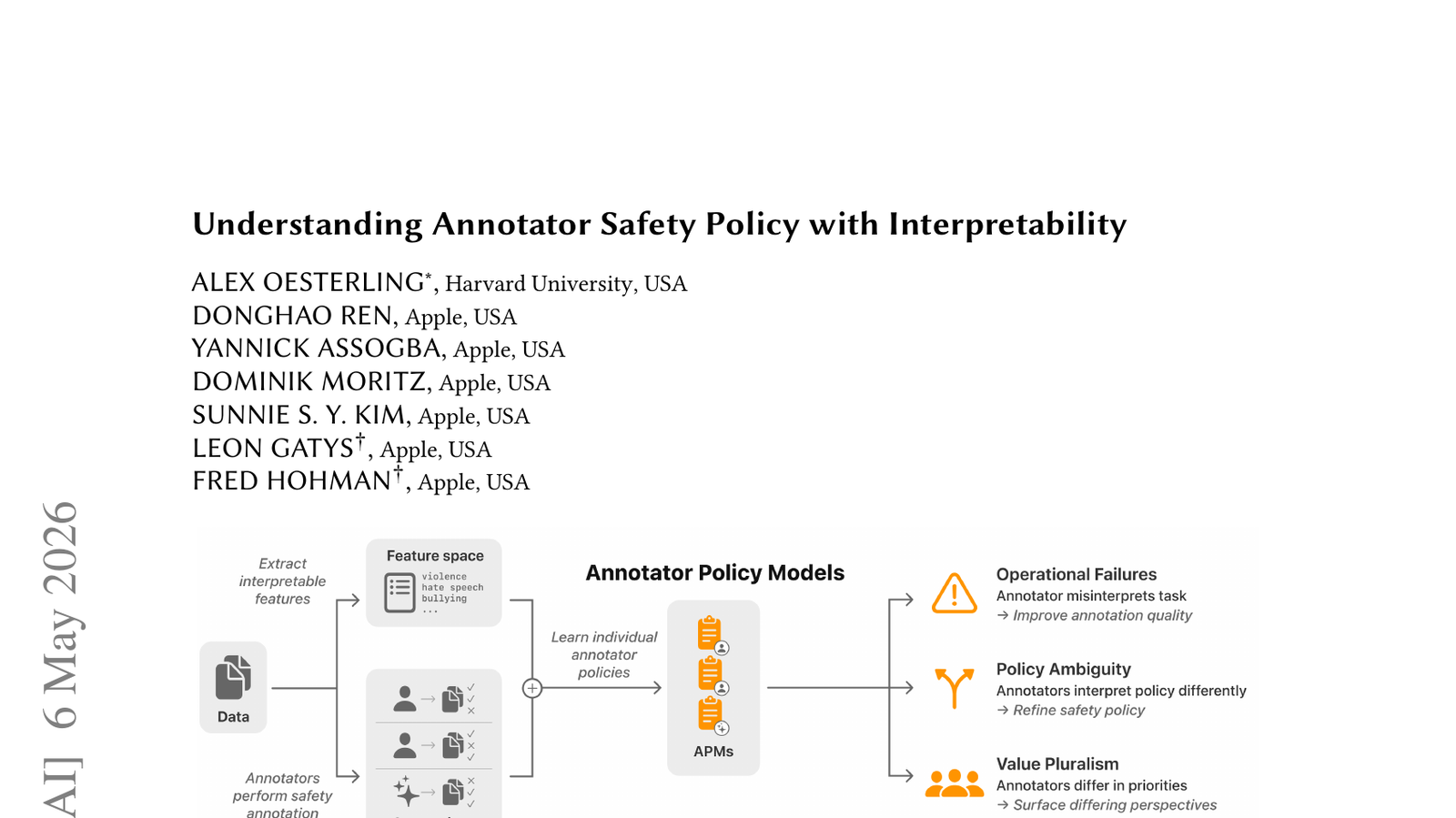

안전 정책은 안전하거나 안전하지 않은 AI 결과물이 무엇인지 정의하며, 데이터 주석 및 모델 개발을 안내하는 중요한 기준입니다. 그러나 주석자(annotator) 간의 의견 불일치(annotation disagreement)는 여전히 해결하기 어려운 문제입니다. 이 논문은 '해석 가능성(Interpretability)'을 통해 주석자 안전 정책을 더 잘 이해하려는 연구를 수행합니다. AI 모델의 안전성을 확보하기 위해서는 모델 자체의 설계뿐만 아니라, 모델을 학습시키는 데이터에 대한 인간 주석자의 일관된 판단이 중요합니다. 주석자 간의 의견 불일치는 안전 정책이 명확하지 않거나, 주석자들이 정책을 다르게 해석하기 때문에 발생할 수 있습니다. 이 연구는 AI 모델의 해석 가능성 기술을 활용하여, 주석자들이 어떤 기준으로 안전성을 판단하는지, 그리고 어떤 부분에서 의견 차이가 발생하는지를 분석합니다. 이를 통해 안전 정책을 더욱 명확하게 수립하고, 주석자 교육을 개선하며, 궁극적으로는 AI 모델의 안전성과 신뢰성을 높일 수 있습니다. 앞으로 AI 안전은 기술적 성능만큼이나, 인간의 가치 판단과 정책 수립이 중요하게 작용하는 영역이 될 것이며, 이 연구는 그 연결 고리를 강화하는 데 기여할 것입니다.

인사이트

이 논문은 AI 안전 정책 수립 과정에서 인간 주석자 의견 불일치 문제를 해석 가능성으로 분석하여, 안전 정책의 명확성을 높이고 AI 모델의 신뢰성 강화에 기여합니다.

이 기사 어땠어요?

여러분의 피드백이 더 나은 맞춤 추천을 만듭니다.